A NVidia lança hoje (lá fora) sua nova placa de vídeo topo de linha, a GeForce GTX 680, cuja GPU é baseada na nova micro-arquitetura Kepler (com produção em processo de 28 nanômetros) e com a promessa de ser a mais rápida do mundo até o próximo anúncio da AMD ou da própria NVidia. A GTX 680 vem acompanha da GeForce 600M, para uso em notebooks, ou melhor, ultrabooks.

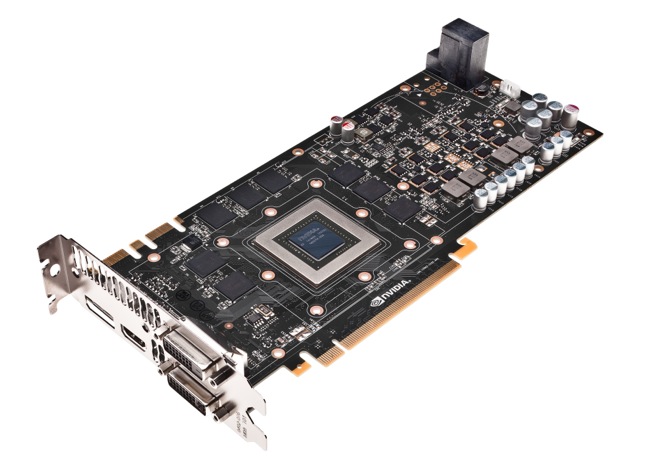

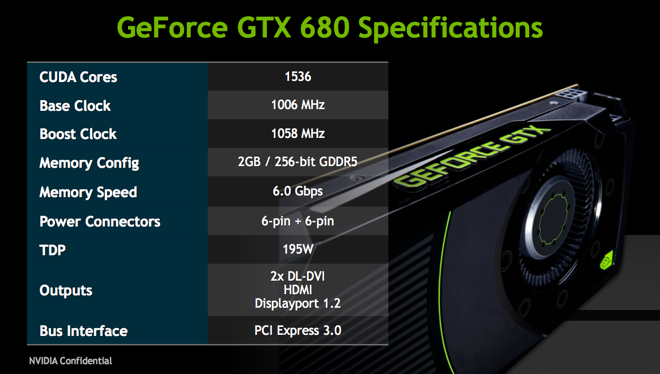

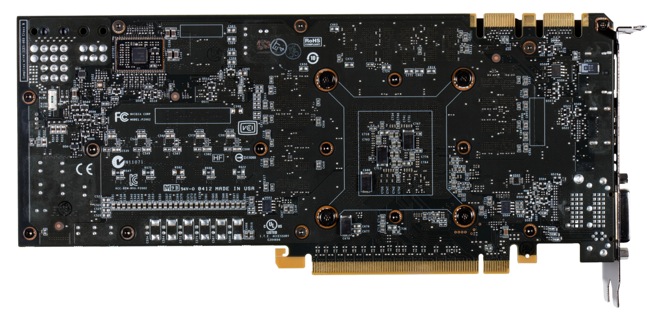

O que tem de importante na GeForce GTX 680? Primeiro, os números enormes das suas especificações técnicas:

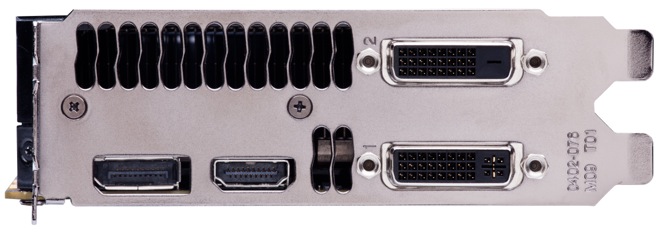

Os novos recursos incluem o SMX, novo bloco processador de fluxo (streaming processor), que traz o dobro da performance por watt em comparação à geração anterior (=menos consumo de energia, o que é ótimo); novos componentes usados na construção da placa para que ela trabalhe de modo silencioso; o GPU Boost, capaz de ajustar as velocidades da GPU sozinha e melhorar o desempenho dos games, novas tecnologias de anti-aliasing (FXAA, TXAA e Vsync Adaptável) para melhorar o visual dos games (como pêlos e fraturas/quebras de objetos) e suporte a até quatro monitores independentes (sendo três em 3D) com uma só placa. Além disso, Kepler é a primeira GPU da casa a ter suporte para PCI-E de terceira geração e DirectX 11.1.

O vídeo abaixo, em inglês, explica melhor a coisa:

[youtube=http://www.youtube.com/watch?v=4SfPLhTgRPQ]

Pra mim, a maior notícia aqui é a melhoria no consumo de energia: a GeForce GTX 680 consome apenas 195W, contra 250W da GTX 580 (geração anterior) ou da concorrente AMD Radeon HD7970.

Nos números oficiais, comparando o desempenho em games, em gráficos divulgados pela NVidia:

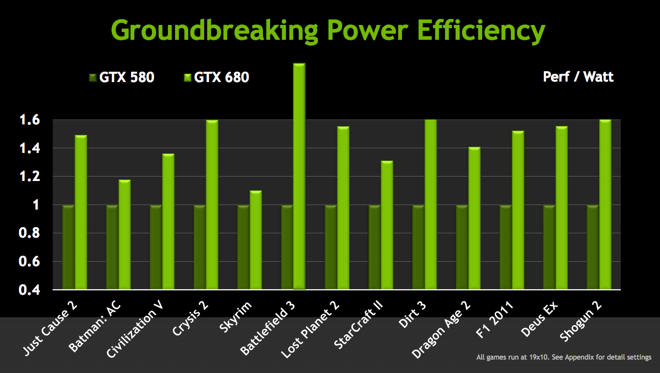

Consumo de energia em relação à versão do ano passado, em desempenho/watt:

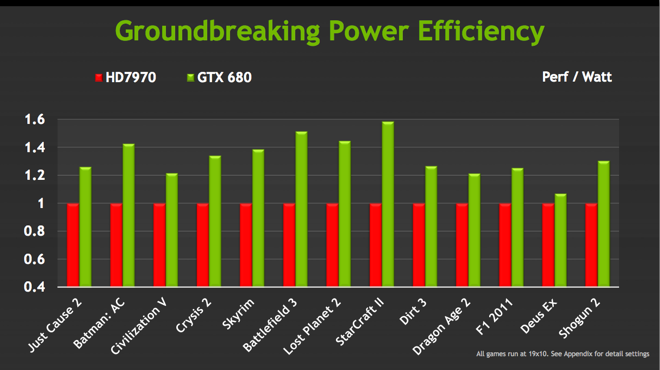

E em relação à Radeon HD 7970, primeiro em desempenho/watt:

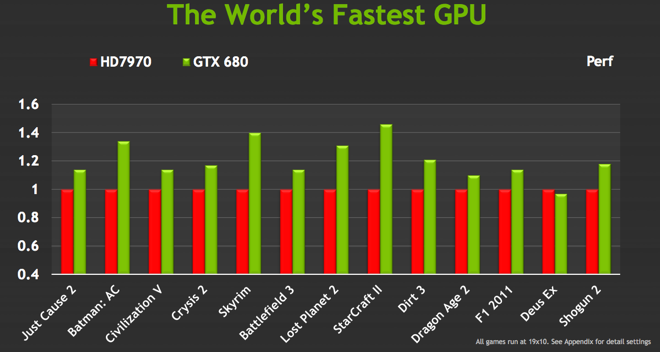

E performance geral:

Nos Estados Unidos, a GeForce GTX 680 chega às lojas hoje pelo preço sugerido de US$ 499 por fabricantes como Asus, Gigabyte, MSI, PNY, entre outras. O preço estimado para a placa no mercado brasileiro é de R$ 1.999.

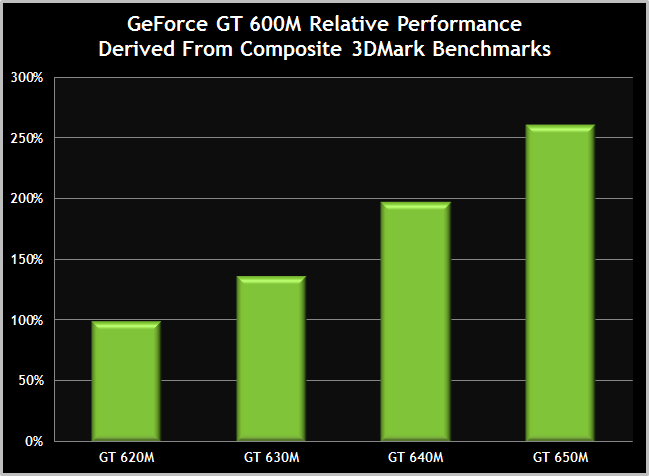

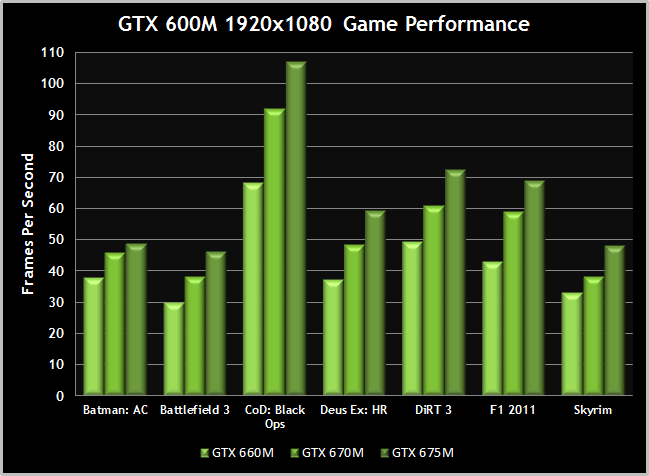

Já a família GeForce 600M, para notebooks, será lançada em máquinas da Acer (como a Aspire Timeline Ultra M3-581TG), Asus, Dell, HP, Lenovo, LG, Samsung, Sony e Toshiba. Seu desempenho, segundo a NVidia, é esse aqui:

Mais informações aqui.

Os dois primeiros gráficos não fazem sentido algum, as leituras da nova Geforce são diferentes para a mesma situação e a leitura das outras duas placas É A MESMA.

A Nvidia podia ao menos apresentar gráficos mais convincentes pra diazer que a sua GPU supera a atual concorrente.

Calma, vamos por partes:

Este é um tipo de gráfico simplificado muito usado por essas empresas (Intel, AMD, NVidia, etc.) onde o resultado do concorrente assume o valor de “1” e o da empresa mostra proporcionalmente o quão o seu produto é melhor. Por exemplo se num jogo o concorrente bate 40 qps e o da empresa 60 qps. Os valores usados serão 1 e 1,5 respectivamente.

Concordo que esse modo de apresentação tem o problema de ocultar alguns resultados, mas ela tem a vantagem de colocar todos os resultados numa mesma escala de fácil compreensão. E cá entre nós: Se eu sou um marketeiro de uma dessas empresas e tenho uma maneira de mostrar meus resultados sem ter que mostrar realmente meus resultados de maneira simples e compreensível… puxa vida, o que mais eu quero?

Esse por sinal é uma das peculiaridades dos gráficos comerciais: se você souber escolher o formato certo e usar as escalas e até as cores corretas você consegue “brincar” com a realidade ao seu bel prazer, seja para o lado bom quanto para o nem tanto. Nossa única salvação é manter o senso crítico e analisar com atenção aquilo que nos é mostrado.

Ok, vai facilitar a leitura e não permite saber os valores da sua placa nova, embora com regra de três dê pra saber o valor dela a partir dos dois gráficos. Ainda assim é muita jogada de marketing, afinal a Nvidia quer vender, não agradar técnicos e engenheiros.

Yep, bem vindo ao mundo real.

É para isso que existem os blogs e sites com reviews. Este texto é apenas a apresentação. Vamos aguardar os reviews, pois a placa foi lançada ontem!

meu caro eles estão comparando uma placa com a outra. O valor 1 é a referência da placa concorrente. Desta forma vc pode perceber quantas vezes a nova é mais rápida nos testes.

Quantos FPS são indicados pro jogo dicar fluente no PC?

Tecnicamente falando, o cinema e a TV trabalham respectivamente a 24 e 30 quadros por segundo (qps). No caso de games, o consenso geral é que qualquer taxa entre 30~60 qps é considerado boa/suficiente para se ter uma boa experiência de uso.

Acima de 60qps.

Só que nesses gráficos o que geralmente aparece é a média dos qps. Sendo que tão importante quanto são os qps "mínimos".

E tem outro detalhe, em jogos de ação 30 qps podem ser perceptivelmente irritantes, mas em um jogo de estratégia (turnos especialmente) não fazer diferença alguma.

Depende do tipo de jogo. Nos jogos de tiro tem que ter uma taxa de 60+, já nos jogos mais "parados" e que necessitam de menor precisão, uma taxa minima de 35 qps é aceitavel.

60 ? Bom, acho que isso depende monitor.

Se levarmos em consideração que a maioria das telas LCDs do mercado trabalham com uma taxa de atualização de tela de 60 Hz — ou seja, 60 quadros por segundo — não adianta a placa de vídeo gerar mais do que 60 qps (quadros por segundo), porque a tela vai simplesmente ignorá-las.

Eu me lembro que a anos atrás, a Intel fez uma pesquisa nos EUA entre usuários de PCs que participaram de uma espécie de "teste cego" experimentando o mesmo jogo em diferentes configurações — na época ainda usando monitores de tubo — que trabalhavam com diferentes números de QPS para ver se eles sentiam alguma diferença. O objetivo neste caso era de determinar qual seria o QPS mínimo para se ter uma boa experiência de uso.

A conclusão que eles chegaram é que, no geral, pouquíssima gente sentiu alguma diferença acima dos 45 qps.

Nvidia tá de parabéns.

Depois de gerações com conflito de personalidade, finalmente chegaram com os dois pés na porta. (Apesar da GF114 ser um chipset competitivo).

GF100 e GF110 claramente eram GPGPUs improvisadas em placa de vídeo. Chip grande que dá trabalho de fabricar, consome e dissipa bicas de energia e tinham uma vantagem de desempenho baixa pro concorrente bem mais barato.

Agora é ver se a AMD se move pra baixar os preços. Tava muito acomodada com as demoras da Nvidia em se acertar com o processo de fabricação…

Viva a concorrência.

E que a TSMC se aprume…

E talvez mais impressionante foi o fato da Nvidia ter conseguido coordenar um lançamento quase global simultâneo.

Apesar dos problemas na TSMC…

Eu ainda vou de ATI.

é tão ridiculo quando alguém apresenta uma visão q é contraria a de outra pessoa, e ela é nagativada por isso.

é no minimo infantil, e gosto é pessoal, cada um tem o seu.

hunf, varias placas vindo com PCI-E 3.0 mas achar motherboard compativel q é bom nada. ¬¬

e a AMD não tem previsão para lançar uma com o suporte, enquanto as da Intel só as mais top. :/

Mas é meio desnecessário se preocupar com isso agora.

Se o consumo de banda entre o 1.0 e o 2.0 só foi percebido mesmo por quem fazia SLI ou Crossfire (e ainda em modo x8). Vai levar um bom tempo pra precisar de 3.0…

Mais preocupante do que isso é a estacionada grotesca que rolou entre os monitores…

Especialmente no Brasil…

Isso sim tiraria proveito dessas placas novas.

é revolta mesmo de quem quer trocar de pc, mas não quer sofrer com uma depreciação instantânea, já q a tecnologia esta praticamente pronta, mas o mercado não parece disposto a adota-lo de imediato. :p

[…] https://interfaces.news/2012/03/22/numeros-enormes-nvidia-geforce-gtx-680-kepler-chegou/ Posted in HPC, Technology […]

[…] Tech Conference 2012 – A arquitetura Kepler voltada aos supercomputadores é o tema principal do evento anual da Nvidia em San Jose, […]